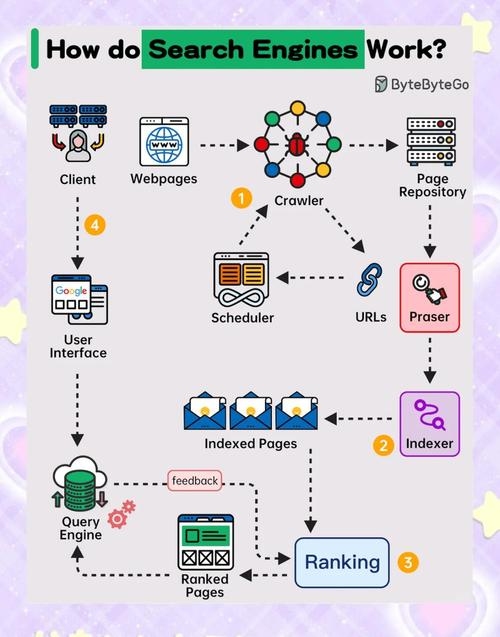

智能搜索引擎工作原理包括多种技术,其中数据抓取系统是核心部分之一,该系统负责链接存储、选取和DNS解析等工作,以实现对互联网数据的快速准确获取和处理,希望此整理回答能对您了解智能搜索引攀技术有所帮助!

- 搜索引擎的主要功能是获取互联网上的信息。

- 它主要通过爬虫(Spider)从种子URL开始抓取数据,不断发现新页面并确保数据的稳定和全面性。

数据抓取系统负责链接存储、选取、DNS解析等工作。

- 主要过程包括搜索、索引、排序等几个主要环节,同时也涉及到过滤、收录以及检索等多个方面。

具体工作流程

- 爬行:搜索引擎放出蜘蛛在互联网上爬行,寻找新的网站和最新的网页内容。

- 抓取与存储:蜘蛛通过超链接分析连续访问并抓取更多网页,这些被抓取的网页被称之为“网页快照”,之后的数据会被存入数据库中以供后续处理和分析。

- 用户查询:当用户使用搜索引擎进行查找时,他们会输入关键词或短语来触发搜索请求,搜索引擎会结合多种算法和技术快速定位相关信息源并进行展示。

- 倒排索引技术:这是实现高效全文搜索的关键技术之一,它基于文件内容的快速定位,倒排索引记录了包含特定词汇的单个文档及其位置关系等信息。

- 目录式搜索引擎的工作原理:人工方式或半自动搜集信息后形成摘要并在分类框架下呈现给用户导航服务,需要维护和维护量较大但信息准确度高且更新及时。

- 其他相关概念解释:什么是搜索引擎?它是如何提高人们提前获取和收集信息的速度并为人们创造更好的网络环境的一种工具;其用途是什么等等。

搜索引擎简介

定义及作用

- 在Internet网上用来查找文件、档案的一个智能化的机器人,理想状态下既具备简单查询能力又具有高级搜索功能的高级化机器人为理想的搜索引擎应该兼具两者特点,其主要目的是为了辅助人们在浩瀚的网络世界中找到所需的信息资源。

应用场景举例

- Yahoo、LookSmart、Open Directory 等都是常见的目录式搜索引擎代表,它们提供了丰富的信息和便捷的服务体验以满足用户的各种需求。

- 全文搜索引擎是目前广泛应用的主流搜索引擎,主要用于处理大量文本数据并提供快速的搜索结果反馈,它可以实现对单词到文档的全文匹配和高效的文件结构映射来实现高效的搜索效果。

技术基础与发展趋势

- 目前主流的搜索引擎依赖于先进的计算机技术和人工智能算法如FST算法、FOR压缩算法和RBM算法等技术手段构建自身的核心技术体系以提高搜索效率和准确性,未来随着技术的不断发展与创新,相信会有更多的新型技术与模式涌现出来为人们的生活带来更大的便利和提高效率和质量水平。

是对您提出的问题进行的整理回答和相关说明,希望能够帮助到您!